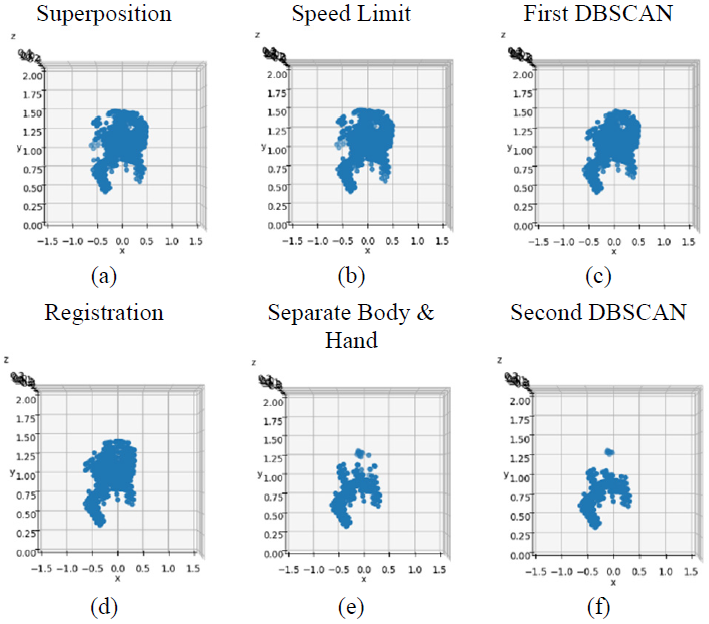

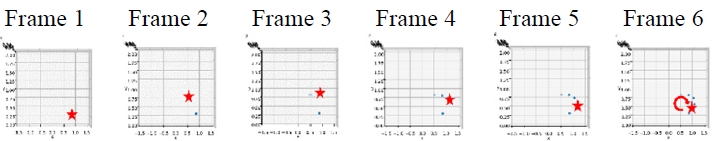

五個手勢的點云數據經過預處理并被分離。圖13展示了逆時針手勢的預處理結果,從左到右的處理步驟包括:疊加、最大速度限制、第一次DBSCAN、對齊、K均值分離手部和身體、第二次DBSCAN。提取了點云的時間序列特征數據用于訓練。為了加快訓練和數據處理速度,我們對數據進行了標準化處理。具體來說,我們將MinMaxScaler應用于時間序列特征數據的(x, y, z)坐標,將數據縮放至0-1范圍。此外,將MaxAbsScaler應用于時間序列特征數據的平均速度,將數據縮放至-1至1的范圍。為了觀察,我們從輸出中抽取了6幀來觀察點云質心的變化。順時針手勢點云質心的變化如圖14所示。紅點代表當前的質心位置,藍點代表之前的質心位置。順時針手勢的質心沿順時針方向移動,逆時針手勢的質心沿逆時針方向移動。類似地,向右手勢的質心水平向右移動,向左手勢的質心水平向左移動。最后,拳擊手勢的質心垂直向上和向下移動。

圖13.逆時針手勢的預處理結果

圖14. 順時針手勢點云質心的變化

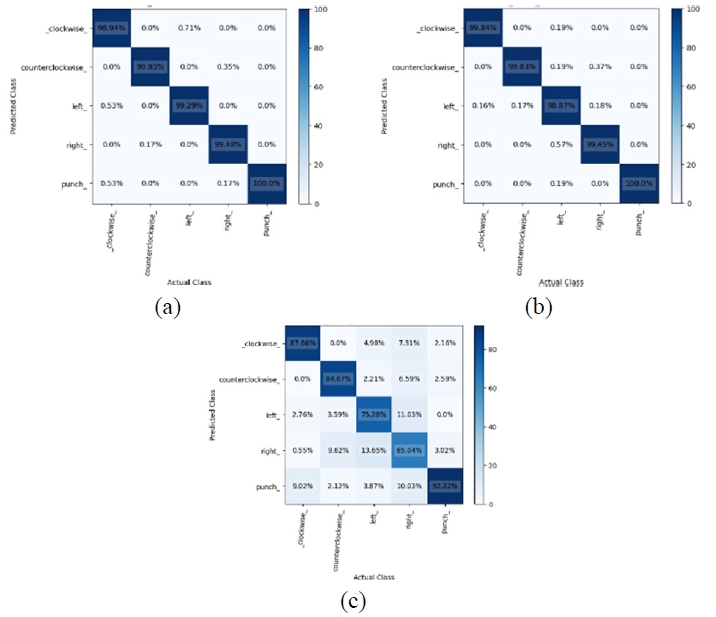

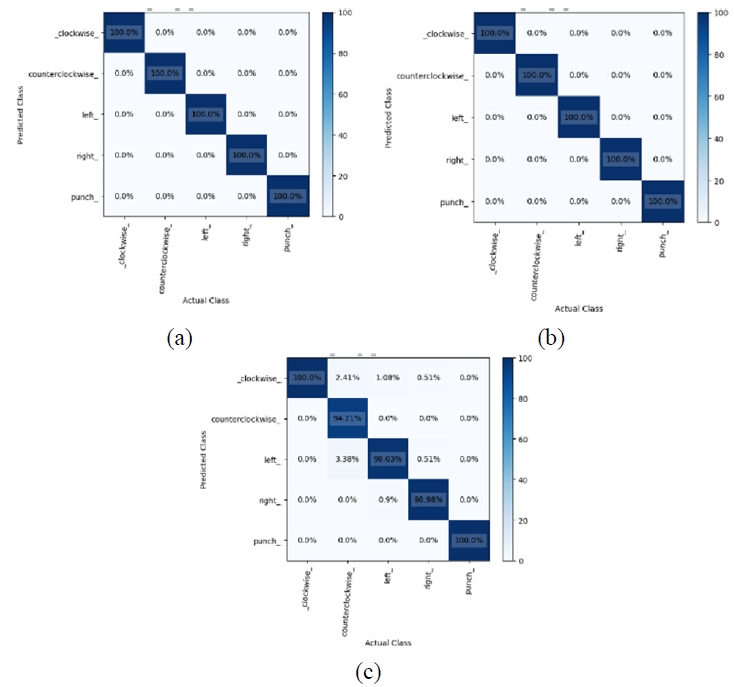

對于五個手勢,總共有14,480條樣本數據。這些數據被隨機重新排序,并分成三組:60%用于訓練,20%用于驗證,20%用于測試。模型使用GRU、LSTM和RNN進行了40次迭代的訓練。圖15展示了這三個模型的混淆矩陣。GRU、LSTM和RNN模型的預測準確率分別為99.51%、99.37%和81.11%。GRU模型的表現優于其他模型。就模型預測時間而言,GRU耗時0.462毫秒,LSTM耗時0.483毫秒,RNN耗時0.461毫秒。RNN模型在預測速度上最快。盡管RNN模型在預測速度上較快,但在準確率上不如GRU和LSTM模型。相比之下,GRU模型不僅更準確,而且在時間消耗上也較少。總的來說,GRU在訓練毫米波手勢識別模型方面表現更好

圖15. (a) GRU,(b) LSTM,以及 (c) RNN 的混淆矩陣

表III顯示了三種模型在實際手勢識別測試中的準確率。在測試每種模型時,我們對每個手勢揮動了10次,并記錄了手勢是否被正確識別。可以看出,GRU模型優于LSTM和RNN模型。

表III. 三種模型在實際手勢識別測試中的準確率

| 模型 | 順時針手勢 | 逆時針手勢 | 向右手勢 | 向左手勢 | 拳擊手勢 | 平均準確率 |

| GRU | 10月10日 | 10月10日 | 10月10日 | 10月10日 | 10月10日 | 10月10日 |

| LSTM | 9月10日 | 9月10日 | 9月10日 | 9月10日 | 9月10日 | 9月10日 |

| RNN | 7月10日 | 7月10日 | 7月10日 | 7月10日 | 7月10日 | 7月10日 |

C. 結合熱成像儀的毫米波雷達手勢識別

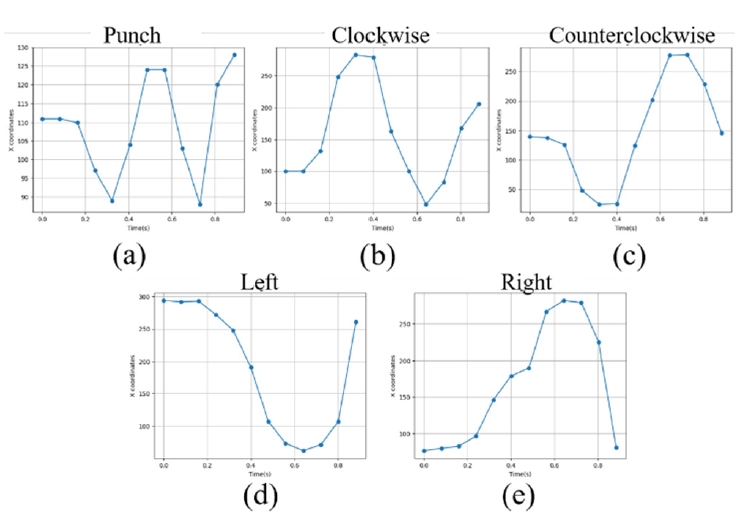

除了毫米波點云數據外,我們還提取了熱成像儀坐標隨時間變化的歸一化時間序列特征數據用于手勢識別。在實際手勢測試中,熱成像儀使用識別手部圖像并記錄手部圖像坐標的隨時間變化。五個手勢的坐標變化結果如圖16所示

圖16. 五個手勢的坐標變化

在手勢識別過程中,毫米波雷達捕獲了20幀的點云數據。然而,用于YOLOv7手部識別的熱成像儀執行速度較慢。在熱成像儀執行12幀手部圖像識別所需的時間內,毫米波雷達可以捕獲20幀數據。如果熱成像儀在某一幀未能檢測到手部圖像,則最終捕獲的時間序列數據少于12幀。為了確保熱成像儀的坐標隨時間變化信息包含在毫米波時間序列特征數據中用于手勢模型訓練,我們對熱成像儀的坐標隨時間變化曲線進行了插值處理。這使得數據增加到了20幀而不改變波形。數據隨后進行了MinMaxScaler歸一化處理。這一過程重復了9次,數據被拼接成200幀的時間序列數據。結合熱成像儀和毫米波雷達的手勢識別模型相較于僅使用毫米波雷達的模型有所改進。在這個模型中,毫米波的平均速度、熱成像儀坐標的時間序列變化以及毫米波時間序列特征數據作為輸入用于訓練。同樣地,模型使用GRU、LSTM和RNN進行了40次迭代的訓練。五個手勢共有14,480條樣本數據。這些數據被隨機重排,并分成三組:60%用于訓練,20%用于驗證,20%用于測試。圖17展示了三個模型的混淆矩陣。GRU、LSTM和RNN模型的預測準確率分別為100%、100%和98.14%。

圖17. GRU、LSTM和RNN模型的混淆矩陣

表IV顯示了實際手勢識別測試的結果,比較了僅使用毫米波雷達與結合毫米波雷達和熱成像儀的準確性。結合使用毫米波雷達和熱成像儀顯著提高了準確性。

這句話意味著表IV提供了實際手勢識別測試中不同配置下的模型準確率對比。具體來說,表IV展示了僅使用毫米波雷達和結合毫米波雷達與熱成像儀兩種情況下的準確率。

表格內容示例:

| 模型配置 | punch | 順時針 | 逆時針 | 左 | 右 | 平均準確率 |

| GRU (毫米波) | 70% | 80% | 80% | 70% | 70% | 74% |

| GRU (+ 熱成像) | 90% | 80% | 80% | 80% | 70% | 80% |

| LSTM (毫米波) | 80% | 90% | 90% | 80% | 80% | 84% |

| LSTM (+ 熱成像) | 50% | 60% | 50% | 40% | 50% | 50% |

| RNN (毫米波) | 70% | 80% | 70% | 70% | 60% | 70% |

| RNN (+ 熱成像) | 70% | 80% | 60% | 60% | 50% | 64% |

IV. 結論

本研究中,采用了一種結合毫米波雷達、熱成像儀和深度學習的大動作手勢識別系統。熱成像儀捕捉了手部圖像的信息,包括坐標運動變化。這些信息與毫米波雷達的點云數據(包括三維坐標和速度)結合,生成了時間序列數據。預處理后的數據被輸入神經網絡進行訓練,開發出手勢識別模型。Jetson Xavier NX嵌入式評估板實現了實時手勢識別。實驗結果表明,結合熱成像儀和毫米波雷達顯著提高了手勢識別的準確性。此外,使用GRU訓練的模型在手勢識別任務中的表現優于LSTM和RNN。

![[靈蜂智能官網]-專業紅外熱像儀廠家](http://linfun.com.cn/wp-content/uploads/2022/06/2022060807191642.png)

![[靈蜂智能官網]-專業紅外熱像儀廠家](http://linfun.com.cn/wp-content/uploads/2021/10/202110130602107.png)